Un guide pour comprendre qui se souvient de quoi, où, et comment; selon que l’on parle de l’orchestrateur Copilot, des agents, ou du Bloc-notes.

1) Pourquoi la contextualisation est la clé (et où jouent la mémoire & les instructions)

Dans une interaction homme–IA, plus que la requête seule, la qualité du contexte détermine la qualité des réponses. Contexte, ici, ce n’est pas un mot magique : c’est l’ensemble des signaux que Copilot peut utiliser pour cadrer sa réponse. L’objectif, le ton, les contraintes, les sources autorisées, et, de plus en plus, ce que l’outil sait de toi et de ton travail.

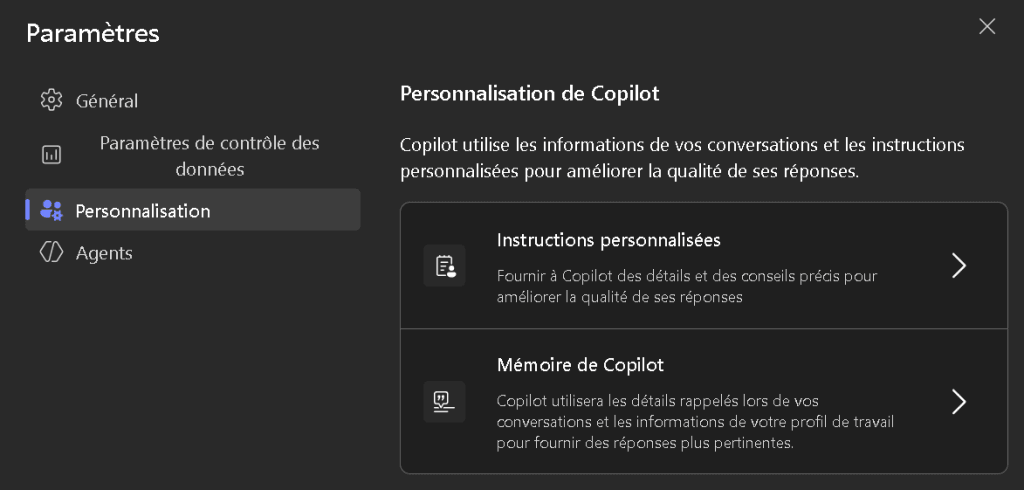

Microsoft encadre cela dans deux mécanismes complémentaires :

- Les instructions personnalisées (prompt persistant). Tu écris des règles de conduite (« Parle en français, donne des exemples Power Platform, structure en 1/2/3 », etc.). Elles n’analysent rien toutes seules ; elles forcent un style, un cadre, des priorités. Elles existent dans plusieurs surfaces Copilot, notamment dans les Notebooks (Bloc-notes), et à travers les agents (où on parle d’“instructions d’agent”).

- La mémoire (profil appris). Copilot peut retenir certains faits utiles sur toi (préférences, habitudes de travail, points récurrents) afin d’éviter les répétitions et de personnaliser les réponses entre les conversations. Cette personnalisation est contrôlable (activation, effacement de points mémorisés) et, côté entreprise, gouvernée par la politique d’Enhanced Personalization.

La bonne nouvelle : ces deux leviers servent la contextualisation, mais ils n’opèrent pas au même niveau.

Les instructions définissent comment Copilot doit se comporter et elles ne peuvent pas contourner les instructions systèmes qui permettent à Microsoft de garantir le respect des Principes Responsables que l’éditeur à choisi de renforcer.

La mémoire lui dit qui tu es et comment tu travailles, pour qu’il anticipe.

L’un est déclaratif et immédiat, l’autre est cumulatif et gouverné par des contrôles d’admin en environnement Microsoft 365.

2) Ce que font Instructions personnalisées, Mémoire et Profil de travail

2.1 Orchestrateur principal : Microsoft 365 Copilot Chat

- Instructions

- Côté utilisateur, Copilot Chat respecte tes instructions temporaires dans le fil de la conversation (« Réponds en puces, cite les sources Microsoft Learn », etc.).

- Côté organisation, les admins fixent des garde-fous (recherche web, image gen, etc.) et les extensions/agents activables. Les agents déclaratifs ajoutés à Copilot sont livrés avec leurs propres instructions d’agent (rôle, ton, but, outils autorisés).

- Mémoire

- Copilot peut mémoriser des préférences transverses entre les conversations (quand la personnalisation/mémoire est activée), consultables/effaçables par l’utilisateur (« Que sais-tu de moi ? », « Oublie que je préfère les tableaux »).

- En tenant compte des contrôles Enhanced Personalization, l’entreprise peut affiner ce que Copilot apprend des usages au travail.

- Profil de travail

- Microsoft EntraID permet à Copilot de connaitre certaines informations sur l’utilisateur comme la fonction, le gestionnaire, etc..

- Copilot ne conserve pas ces informations. Il est autorisé à y accéder au travers de Microsoft Graph.

- Type de compte

- Distinction compte professionnel vs personnel, avec comportements associés (accès au Graph, agents, etc.) et politique multi-compte dans les apps Office. Le « profil de travail » te situe côté pro et conditionne l’accès aux données M365 et aux agents.

2.2 Agents (déclaratifs, créés avec Copilot Studio Light / Pro)

- Instructions

- C’est le Cœur de l’agent : un jeu d’instructions déclaratives (but, style, limites), plus des outils (plugins/API), plus des sources de connaissance. Ce cadre agit à chaque invocation de l’agent, que ce soit dans Copilot Chat (agent embarqué) ou en surface autonome (Teams, web, etc.).

- Mémoire

- Deux étages :

- Mémoire utilisateur (préférences de la personne, si activée) ;

- État conversationnel/notes gérés par l’agent (selon la conception), sans que cela devienne automatiquement une mémoire trans-sessions côté utilisateur.

- Les quotas/limites et la gouvernance restent ceux de Copilot Studio/Dataverse (RPM, capacités).

- Deux étages :

- Type de compte

- Les agents travail héritent de la sécurité M365 (Graph, contrôles d’admin, données d’entreprise). Invqués dans Copilot Chat, ils opèrent sous le contexte pro.

2.3 Bloc-notes / Copilot Notebooks

- Instructions

- Les Notebooks permettent d’ajouter des instructions Copilot persistantes au document (format attendu, ton, objectifs), qui s’appliquent aux interactions dans ce Notebook. C’est la façon la plus explicite d’avoir un « brief » collé au support de travail.

- Mémoire

- On parle surtout de persistance de contexte au niveau du Notebook : le fil et les pages restent, se versionnent et se partagent selon les réglages Loop/SharePoint Embedded (stockage et permissions). Ça n’est pas la même chose que la mémoire personnelle trans-chats de l’utilisateur.

- Type de compte

- Par défaut, un Notebook du profil de travail vit dans le tenant (stockage géré par M365), respecte les politiques de partage, d’audit, et les limites d’externes/guests.

3) Différences pratiques : quand écrire des instructions, quand s’appuyer sur la mémoire

Utilise les instructions quand tu veux un comportement fiable et contrôlé dès maintenant, dans une surface précise (agent ou Notebook) : structure, ton, formats, préférence d’exemples, interdictions explicites, sources autorisées. Les instructions sont déterministes et auditables par design.

Appuie-toi sur la mémoire quand la préférence est transverse et répétitive (ex. « réponds d’abord en français », « privilégie les références Microsoft Learn », « je suis formateur Power Platform »), et que ton organisation autorise cette personnalisation. Tu peux vérifier/effacer ce que Copilot retient et les admins peuvent circonscrire ce périmètre.

4) Sécurité, gouvernance et confidentialité

Gouvernance M365 : l’orchestrateur et les agents respectent les politiques d’accès, d’audit et de rétention (eDiscovery, journaux). La personnalisation « mémoire » côté travail se gère par Enhanced Personalization.

- Contrôle utilisateur : tu peux voir, corriger et oublier des éléments mémorisés. Sur le grand public, Microsoft rappelle pouvoir conserver les historiques (paramétrable) et offre un panneau de confidentialité pour exporter/effacer.

- Limites/quotas agents : attention aux RPM et capacités des agents (impact concret sur la robustesse perçue).

5) Tableau récapitulatif

| Surface / Situation | Instructions personnalisées – Disponibles ? | Exemples d’instructions efficaces | Mémoire – Disponible ? | Exemples de mémoire utile |

|---|---|---|---|---|

| Copilot Chat (orchestrateur principal, compte travail) | Oui (dans le fil + via agents embarqués) | « Réponds en français, structure en Contexte/Étapes/Risques, cite Learn en fin. » • « Ne propose que des connecteurs standard Power Platform. » | Oui, si personnalisation activée par l’org + utilisateur | « Je suis formateur M365 ; priorise Power Platform » • « Je préfère les checklists et les tableaux » • « Mes réunions durent 90 min par défaut » |

| Agent dans Copilot Chat (agent déclaratif étendu) | Oui (instructions d’agent) | Rôle/objectif de l’agent, style sobre, tools autorisés, format de sortie (JSON, tableau), guardrails (« ne jamais appeler X »). | Partiel : l’agent exploite la mémoire utilisateur si disponible + peut stocker un état métier (selon design) | Préférences de l’utilisateur rappelées au lancement • Petites notes de session de l’agent (ex. dernier dossier consulté) selon conception. |

| Agent hors Copilot Chat (ex. Teams, web dédié) | Oui (mêmes instructions d’agent) | Idem ci-dessus, plus « lors d’échec API, propose un plan B » • « Réponds par cards adaptives ». | Partiel : mémoire utilisateur si surface la supporte ; sinon état local/logique côté agent | « Souviens-toi de ce ticket jusqu’à clôture » (mémoire agentique) • Réafficher le dernier résultat pour continuité. |

| Bloc-notes / Copilot Notebooks | Oui (instructions liées au Notebook) | « Dans ce Notebook, écris exposés 600–800 mots, ajoute un sommaire, cite 3 refs Learn. » • « Utilise le tone pédagogique ». | Contexte persistant du Notebook (pages, historique) plutôt que « mémoire personnelle » | Conserver la trame d’un cours, les itérations sur un article, les to-dos attachés au document. |

| Copilot Chat (profil personnel grand public) | Oui (dans le fil) | « Réponds en pas-à-pas », « Toujours donner une TL;DR ». | Oui (Mémoire grand public ; activable/désactivable, effaçable) | « Je préfère les exemples Python », « J’habite Montréal », « Je déteste les emojis ». |

| Multi-compte dans les apps Office (Word/Excel/Outlook) | N/A centralisé (cela dépend du fil/agent) | — | Dépend du compte utilisé (travail vs perso) et des politiques multi-compte | Comportements différenciés : accès Graph, réponses ancrées doc, etc. |

Rappel utile de pratique : les instructions sont ton contrat, la mémoire est ton profil.

Dans le doute, contractualise d’abord (instructions), puis laisse apprendre (mémoire) là où c’est autorisé et utile.

6) Conseils d’implémentation

- Verrouille le “qui fait quoi” par surface

- Rédige les instructions d’agent comme un brief de produit (objectif, limites, I/O, erreurs). Teste sous charge en tenant compte des quotas Copilot Studio.

- Utilise le Bloc-notes comme “brief persistant par livrable”

- Ajoute les Copilot instructions au Notebook de cours/projet ; elles deviendront le rails de chaque itération, partageables et auditables.

- Active la personnalisation avec discernement

- Côté tenant, décide si Enhanced Personalization est autorisée, pour qui, et avec quel accompagnement (information aux utilisateurs, FAQ de confidentialité, procédure d’oubli).

- Rends la mémoire visible & réversible

- Institue le réflexe « Que sais-tu de moi ? » + « Oublie X » dans les guides d’usage. Propose un lien vers le tableau de bord confidentialité pour exporter/effacer.

- Évite les confusions de périmètre

- Un agent n’“apprend” pas magiquement pour tous le monde : sans design explicite, son état reste dans la session ou dans sa logique. La mémoire utilisateur est différente, gouvernée par les politiques de l’org.

Mais le conseil ultime?! Utilise Copilot pour écrire les insctructions!

Dans une conversation, consolide le contexte et ajuste exactement ce que tu veux mettre en place dans tes instructions, puis, demande à Copilot, « Écrit moi la requête complète que je pourrais utiliser pour définir les instructions »

Attention: Certaines instructions (par exemple dans Copilot Studio Light) sont limitées à 2000 caractères. Alors demandez à Copilot d’écrire la requête en moins de 2000 Caractères.

Conclusion

La contextualisation n’est pas un luxe, c’est la colonne vertébrale de la qualité.

Les instructions personnalisées sont le levier direct : tu fixes le cadre, tu obtiens de la constance.

La mémoire est le levier transversal : elle réduit la friction et personnalise l’assistant à l’échelle du temps et des surfaces, sous contrôle utilisateur et gouvernance entreprise.

Dans Copilot, ces deux mécaniques se complètent : contractualise d’abord (agents/Notebooks), personnalise ensuite (mémoire & profil de travail), et gouverne toujours (sécurité, confidentialité, quotas).

Références officielles (consultées pour cet article)

- Microsoft 365 Copilot – Hub & gouvernance : documentation d’ensemble, sécurité/audit, adoption. Hub Microsoft 365 Copilot

- Enhanced personalization control (Graph) : contrôle admin de la personnalisation au travail. Vue d’ensemble du contrôle de personnalisation amélioré

- Privacy & Memory côté Copilot : voir, effacer ce que Copilot retient de toi ; gestion de l’historique et tableau de bord. Microsoft Copilot contrôle de confidentialité

- Copilot Chat – gestion admin (activation, épinglage, web, etc.). Gérer Microsoft 365 Copilot Chat

- Agents : écrire des instructions d’agent, extensions, outils/API, modèle « lite build ». Écrire des instructions efficaces pour les agents déclaratifs

- Quotas & limites Copilot Studio (Dataverse/RPM, capacité). Quotas et limites pour Copilot Studio

- Notebooks / Pages : instructions dans Notebooks, stockage & permissions (Loop / SharePoint Embedded). Fournir des instructions personnalisées pour votre bloc-notes Microsoft 365 Copilot

- Profils, comptes & comportement multi-compte dans les apps Office (accès Graph, capacités). Accès à plusieurs comptes à Copilot pour les documents professionnels et scolaires

- Présentation publique de la mémoire Copilot (consumer) : pages Microsoft sur la fonctionnalité et son activation. Copilot doesn’t just remember, it also understands you